喜讯!TCMS 官网正式上线!一站式提供企业级定制研发、App 小程序开发、AI 与区块链等全栈软件服务,助力多行业数智转型,欢迎致电:13888011868 QQ 932256355 洽谈合作!

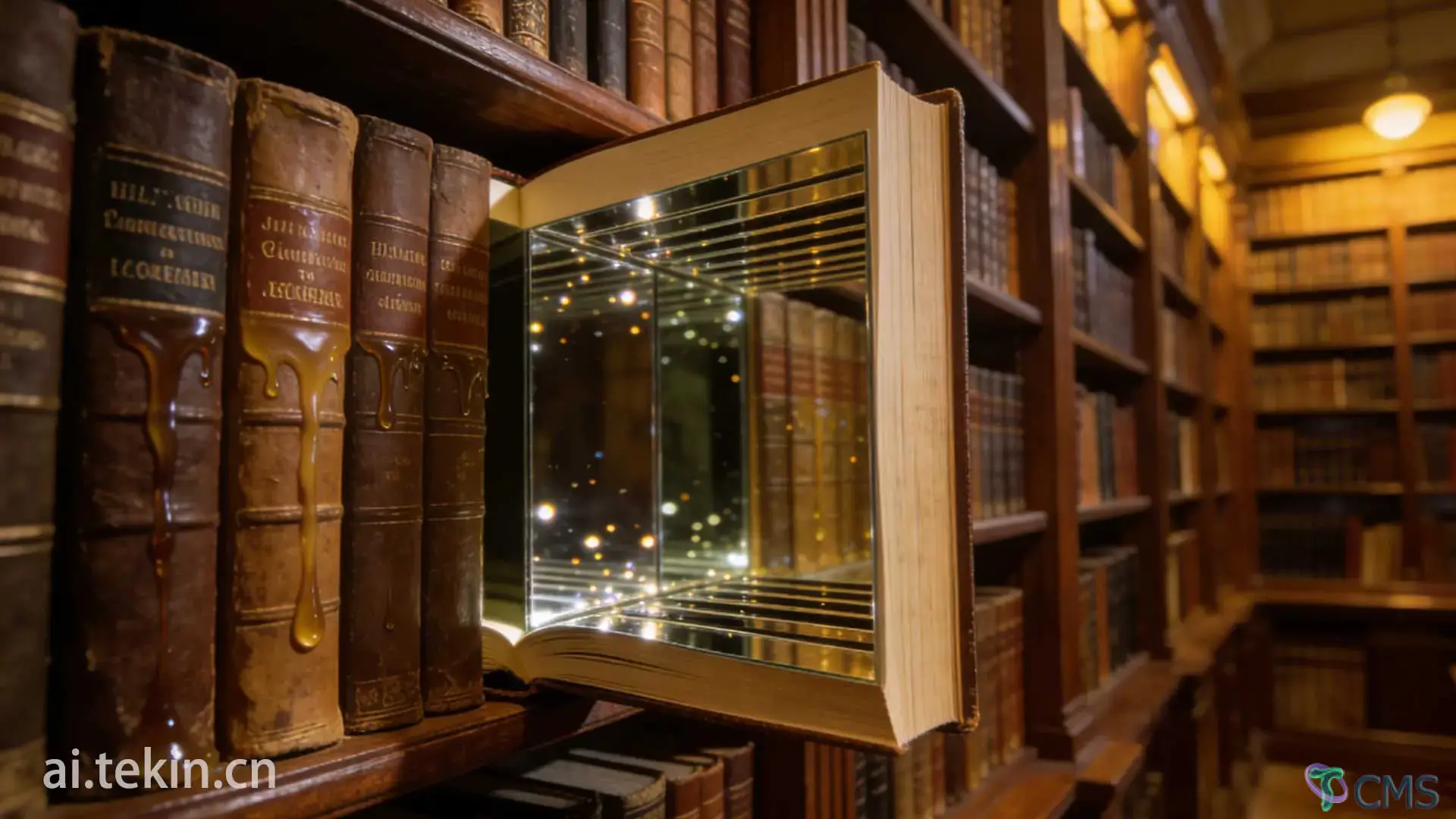

问AI一本不存在的书,它能给出详细书评——作者、出版社、章节目录、核心论点,一应俱全。2023年《Nature》研究确认,AI会编造格式完美却不存在的学术引用。CABI研究发现AI"推演幽灵参考文献"来匹配用户需求,无论其真实与否。本文解释语言模型如何习得书籍结构并将这些模板应用于生成逼真但虚构的内容。影响是严重的:AI生成的虚假论文已出现在学术生态系统中,编造的引用可能被当作真实来源接受。

AI 不知道这本书是否存在,但它知道"一本书应该长成什么样"。

所以你给它一个书名,它就能给你编出一整本"书"。

这句话能瞬间击中读者的认知盲区:

AI 的"编书能力"不是巧合,而是底层机制——它只是在套用模板。

你可能试过:让 AI 介绍一本你随便编的书。它会立刻给你:作者、出版社、出版年份、内容简介、章节目录、每章核心观点、甚至"读者评价"和"学界影响"。

你会以为它"真的读过这本书"。

但真相是:

它不是在引用一本书,而是在生成一本书。

这不是个案,而是 AI 的普遍特性。2023年,《Nature》发表了一项研究,专门调查 AI 的"幻觉"现象——研究人员发现,AI 会编造完全不存在于真实世界中的参考文献和书籍引用。这些虚构的引用看起来格式完美、信息详实,但根本不存在。

AI 在训练中读过海量书籍相关内容:书评、目录、摘要、论文引用、读书笔记、电子书片段、出版信息。

它学到的不是"知识",而是"结构"。

一本书通常包含:主题、作者背景、章节结构、论点展开、案例支持、总结升华。

于是你给它一个书名,它就会自动补全:

"一本书应该有的所有元素"。

CABI(国际应用生物科学中心)的研究指出:AI 会根据用户的提示"推演"出幽灵参考文献,完美匹配用户的需求,无论它们是否真实存在。 你要什么,它就给你"造"什么——格式对、内容对、就是不存在。

因为它学到:章节标题通常是名词短语,章节顺序通常从"概念 → 案例 → 方法 → 总结",每章都有"逻辑递进",每章标题要"看起来专业、有深度、有结构"。

于是它会生成:

这些结构非常"像真的",但完全可能是假的。

AI 不知道这本书是否有第3章,它只知道"人类在介绍书的时候通常会写第3章"——所以它就写了。

因为它学到:简介通常包含"背景 + 问题 + 方法 + 价值",语言风格通常是"专业 + 概括 + 稍微夸张",人类写简介时喜欢用"这本书将带你……"。

于是它会生成:"这本书深入探讨了……"、"作者以独特视角分析了……"、"本书适合对××感兴趣的读者……"。

这些句式在语言模式中出现频率极高,所以它会自然生成。

台大图书馆在2023年的一项分析中指出:ChatGPT 生成的参考文献"真假难辨"——有些引用确实存在,有些完全是编的,但格式都完美符合学术规范。用户很难分辨哪些是真的、哪些是假的。

因为它学到:每章都需要"一个中心思想",每章都需要"一个逻辑链",每章都需要"一个案例或论证"。

于是它会自动补全:"本章主要讨论……"、"作者认为……"、"通过案例××,本章说明……"。

这不是"理解",是"叙事模板"。

AI 不是在总结书的内容,而是在生成"人类总结书时通常会说什么"。

因为它学到:理论通常由"定义 + 原理 + 应用"组成,人类喜欢用抽象名词构建理论,语言模式能让虚构理论看起来"很专业"。

于是它能生成(假设性示例):"情绪动力学模型"、"认知流动框架"、"结构化行为路径"。

这些听起来很厉害,但可能完全不存在。

《Rolling Stone》在2025年的一篇报道中警告:AI 正在创造一个"虚假学术生态系统"——不存在的论文、不存在的书、不存在的研究,正在威胁人类知识体系本身。 当 AI 编造的内容被当作真实引用传播,虚假就会变成"共识"。

因为它学到:作者通常有"学历 + 研究方向 + 机构",作者背景越具体越可信,人类喜欢把"专业性"与"权威性"绑定。

于是它会补出:"某大学教授"、"研究方向为××"、"曾在××机构任职"。

这些信息可能完全是编的,但语言模式让它们"看起来合理"。

知乎上一位用户分享了自己的经历:让 ChatGPT 推荐参考文献,结果给出的论文"期刊名称对、年份对、页码对,但去官网查根本不存在"。AI 不是在"撒谎",它只是在生成"最像参考文献的东西"。

AI 的强大之处在于:它能模仿书籍的结构、它能模仿作者的语气、它能模仿学术的风格、它能构造自洽的逻辑链、它能补出大量细节。

于是你看到的不是"真实的书",而是一个:

"语言模式驱动的虚构书籍"。

但它看起来非常真实。

GPTZero 的一项调查发现:NeurIPS 会议(人工智能顶级会议)上,约一半含有"幻觉引用"的论文,本身也高度疑似 AI 生成。AI 编造引用 → 论文被接受 → 成为新的"学术来源"——虚假正在自我繁殖。

现在我们可以更清楚地看到两种逻辑的根本差异:

人类理解书籍:

AI 生成书籍:

当你把"语言生成"误认为"内容理解",你就会以为 AI "读过这本书"。但实际上,它只是在按照模板"编造",从未见过真正的书。

AI 不是在"介绍一本书",而是在"生成一本书的语言结构"。

它不是在告诉你真相,而是在告诉你:

"人类通常会这样写一本书。"

理解这一点,我们才能:

理解 AI 的"书籍幻觉",才能真正理解它的边界。

这是系列《智能的错位:AI 幻觉的底层逻辑》第 7 篇。

下一篇:《人类逻辑 vs AI 逻辑:两种智能的根本差异》

——为什么人类和 AI 的"智能"根本不是同一回事?

理解底层逻辑,是理解智能时代的第一步。